[Current Research] Secure AI

- 0

- 0

- 07-19

AI모델의 보안에 대한 연구 (Secure AI)

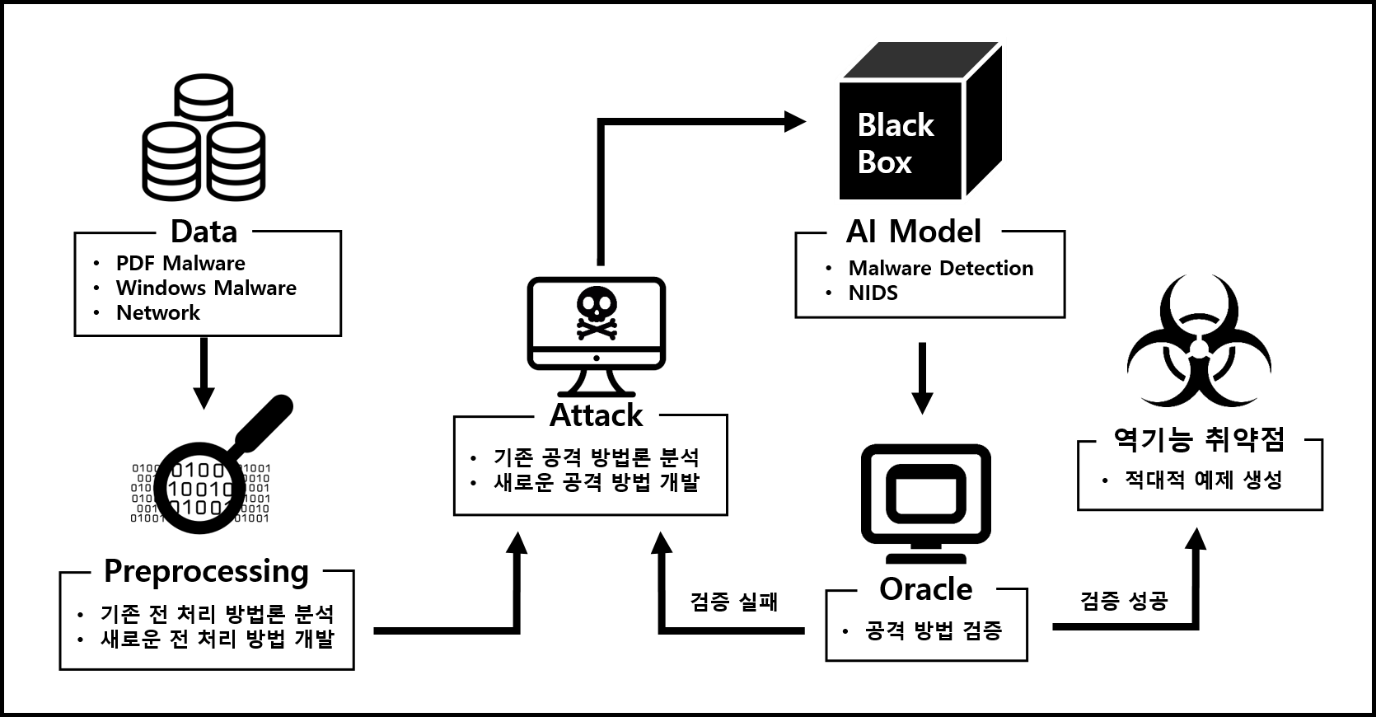

다양한 분야에서 AI 모델이 활용되기 시작하면서 그 영향력이 확대되자 학계에서는 AI 모델 자체의 보안성에 대한 연구의 중요성이 대두되었다. 이는 자율주행자동차의 표지판 인식 등에 대한 공격 사례들을 통해 실제 위협이 될 수 있음이 입증되었으며, 학계에서는 아직 이와 같은 AI 모델에 대한 공격에 대해 완전한 방어법을 찾지 못해 지속적으로 풀어나가야 하는 열린 문제로 여기고 있다. 현재 방어법으로 AI 모델을 공격하여 적대적 예제 (Adversarial Example)을 생성하여 해당 모델에 내제되어 있는 역기능 취약점을 발견하는 것이 활발히 연구되고 있다. 발견된 역기능 취약점을 해결하기 위하여 생성된 적대적 예제를 재 학습하여 AI 모델의 강건성 (Robustness)를 높이는 방법론이 연구되고 있다. 또한 이러한 적대적 예제를 생성하기 위해서 딥러닝 기술을 활용하고 있다. 본 연구실에서는 다양한 도메인의 AI 모델에 대하여 딥러닝 기술을 활용해 역기능 취약점을 발견하여 AI 모델 자체의 보안성을 지키고 강건선을 높이는 연구를 진행하고 있다.

Generating Adversarial Example for PDF Malware Classifier (Younghan Lee, Yohan Kim)

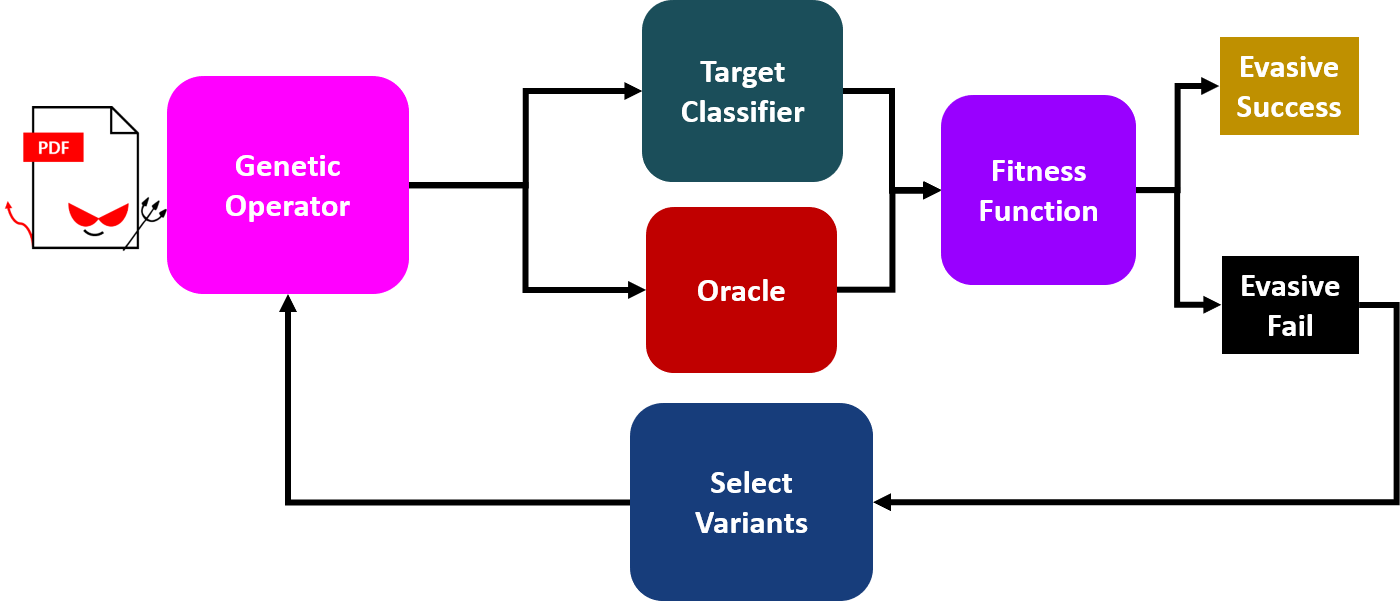

PDF (Portable Document Format) 파일은 실생활에 널리 사용되고 있는 파일 포맷이다. 많은 사람들이 사용하는 만큼 PDF 파일은 공격 대상으로도 널리 사용되고 있다. 최근 통계에 따르면 PDF 파일에 대한 공격이 새로운 위협의 38%를 차지하였으며 PDF reader의 취약점 또한 꾸준히 발견되고 있다. 이러한 PDF 파일에 대하여 PDF malware를 탐지하는 연구가 진행되고 있다. PDF malware의 종류는 점점 다양해지고 공격자의 은닉 기술 또한 발전하고 있지만 Rule에 의존한 전통적인 탐지 기법은 기존에 발견된 PDF malware의 패턴에 기반하기 때문에 신종 악성 PDF malware 탐지에 실패할 수 있다. 이러한 한계점을 극복하기 위해 최근 AI 기술을 활용한 PDF malware 탐지 기법이 활발하게 연구되고 있다. AI 기술을 활용한 PDF malware 탐지 모델은 데이터의 숨겨진 규칙을 스스로 학습하여 새로운 형태의 PDF malware를 효율적으로 수행할 수 있다. 이러한 AI 기반의 PDF malware 탐지 모델에 대하여 성능과 더불어 모델에 대한 robustness를 보증하는 것은 중요한 과제이다. PDF malware 탐지 AI 모델에 대한 robustness 평가 및 향상시키기 위해 adversarial example 활용하는 방법이 있다. 성공적인 adversarial example을 생성하기 위해서는 PDF malware 탐지 모델을 회피하면서 PDF malware의 악성 행위 및 기본적인 PDF 파일의 구조를 유지해야한다. 본 연구에서는 PDF malware 탐지 모델에 대하여 robustness를 검증 및 향상시키기 위한 adversarial example generation에 대한 연구를 진행하고 있다.

Windows Malware Analysis using Deep Learning (Younghan Lee, Yoongi Cho)

점점 더 다양한 공격기법이 연구됨에 따라 기존 Rule-based 형식의 백신은 신종 멀웨어에 대해 충분히 탐지하지 못하고 있다. 이는 Rule-based의 특징으로 사전에 설립한 규칙에 따라 멀웨어를 탐지하기 때문에 새로운 유형의 멀웨어들은 기존 규칙으로 탐지하기 어렵기 때문이다. 이를 해결하기 위해 AI를 활용한 백신이 많이 연구되고 있지만 대부분의 경우 멀웨어의 악성행위가 아닌 멀웨어가 가지고 있는 부수적인 특징을 학습하고 있기 때문에 본질적인 목표에 도달하기 어렵다. 본 연구실에서는 멀웨어의 본질적인 악성행위를 AI가 학습하기 위한 방법론과 AI-based 백신의 강건성에 대해 연구를 진행하고 있다.